Código en Python y TensorFlow para realizar una clasificación binaria utilizando un perceptrón en TensorFlow. En este caso, se implementará un perceptrón simple para clasificar datos en dos clases distintas.

- Perceptrón: Un perceptrón es un tipo de neurona artificial que se utiliza en redes neuronales para realizar clasificación. Toma un conjunto de entradas, las pondera y las suma, y luego aplica una función de activación para producir una salida binaria. La función de activación más comúnmente utilizada es la función sigmoide, que produce valores en el rango [0, 1].

- Umbral de Decisión: El perceptrón tiene un umbral de decisión. Si la suma ponderada de las entradas es mayor o igual que el umbral, el perceptrón emite una salida de 1 (o «verdadero»). Si es menor que el umbral, emite una salida de 0 (o «falso»). El umbral es uno de los parámetros que el perceptrón aprende durante el entrenamiento.

- Clasificación Binaria: En el contexto de clasificación binaria, el perceptrón toma decisiones sobre a cuál de las dos clases pertenece una entrada. Por ejemplo, en un problema de clasificación de correos electrónicos como spam o no spam, el perceptrón decide si un correo es spam (clase 1) o no spam (clase 0) en función de sus características.

import tensorflow as tf

import numpy as np

import matplotlib.pyplot as plt

# Crear datos de entrenamiento

np.random.seed(0)

X = np.array([[1, 2], [2, 3], [2, 2.5], [3, 4], [4, 3], [5, 5]])

Y = np.array([0, 0, 0, 1, 1, 1]) # Etiquetas binarias (0 o 1)

# Definir el modelo del perceptrón

model = tf.keras.Sequential()

model.add(tf.keras.layers.Input(shape=(2,)))

model.add(tf.keras.layers.Dense(1, activation='sigmoid'))

# Compilar el modelo

model.compile(optimizer='adam', loss='binary_crossentropy', metrics=['accuracy'])

# Entrenar el perceptrón

model.fit(X, Y, epochs=1000, verbose=0) # Entrenamiento por 1000 épocas

# Evaluar el modelo

loss, accuracy = model.evaluate(X, Y)

print(f'Pérdida: {loss:.4f}')

print(f'Precisión: {accuracy*100:.2f}%')

# Visualizar la decisión del perceptrón

plt.scatter(X[:, 0], X[:, 1], c=Y, cmap='coolwarm')

ax = plt.gca()

xlim = ax.get_xlim()

ylim = ax.get_ylim()

# Generar puntos para trazar la línea de decisión

xx, yy = np.meshgrid(np.linspace(xlim[0], xlim[1], 100), np.linspace(ylim[0], ylim[1], 100))

xy = np.column_stack([xx.ravel(), yy.ravel()])

Z = model.predict(xy).reshape(xx.shape)

plt.contour(xx, yy, Z, levels=[0.5], colors='k')

plt.title("Decisión del Perceptrón")

plt.show()

Este código realiza lo siguiente:

- Genera Datos de Entrenamiento: Se crean datos de entrenamiento

Xy etiquetasYpara la clasificación binaria. En este caso,Xson las características yYson las etiquetas binarias (0 o 1). - Define el Modelo del Perceptrón: Se define un modelo de perceptrón utilizando TensorFlow y Keras. El modelo consta de una capa de entrada y una capa densa con una función de activación sigmoide. Este modelo es adecuado para realizar una clasificación binaria.

- Compila el Modelo: El modelo se compila especificando el optimizador (‘adam’) y la función de pérdida (‘binary_crossentropy’) para el entrenamiento. Además, se mide la precisión como métrica.

- Entrena el Modelo: Se entrena el modelo en los datos de entrenamiento

XyYdurante 1000 épocas. - Evalúa el Modelo: El modelo se evalúa en los mismos datos de entrenamiento y se muestra la pérdida y precisión obtenidas durante el entrenamiento.

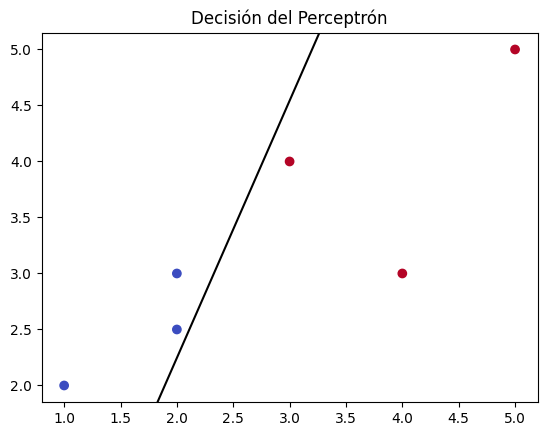

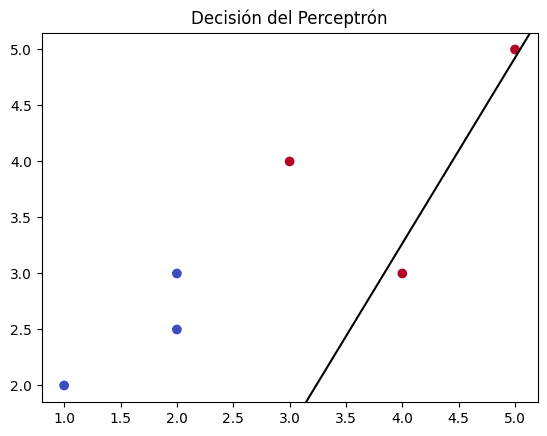

- Visualiza la Decisión del Perceptrón: Se utiliza Matplotlib para visualizar cómo el perceptrón divide el espacio en dos regiones (una para cada clase) en función de su capacidad de predicción. Esto se logra mediante un gráfico de dispersión y la representación de la línea de decisión del perceptrón en el espacio bidimensional.

En el código anterior, la visualización de la «decisión del perceptrón» muestra cómo el perceptrón divide el espacio en dos regiones: una región donde emite una salida de 1 (clase positiva) y otra región donde emite una salida de 0 (clase negativa). Esta división se basa en los pesos del perceptrón y el umbral de decisión que el modelo ha aprendido durante el entrenamiento. La visualización te permite ver cómo el perceptrón realiza la clasificación en un espacio bidimensional y cómo dibuja una línea de decisión para separar las dos clases.

Pérdida: 0.4021 Precisión: 100.00%

Pérdida: 0.8083 Precisión: 33.33%

Este es un ejemplo simple de clasificación binaria utilizando un perceptrón en TensorFlow. Puedes experimentar con diferentes conjuntos de datos y configuraciones de perceptrón para obtener una comprensión más profunda de cómo funciona.

Your blog has helped me through some tough times and I am so grateful for your wise words and positive outlook

Puraburn Nice post. I learn something totally new and challenging on websites

Puraburn I just like the helpful information you provide in your articles

Mitolyn I’m often to blogging and i really appreciate your content. The article has actually peaks my interest. I’m going to bookmark your web site and maintain checking for brand spanking new information.

Mitolyn I am truly thankful to the owner of this web site who has shared this fantastic piece of writing at at this place.

Hi i think that i saw you visited my web site thus i came to Return the favore I am attempting to find things to improve my web siteI suppose its ok to use some of your ideas

Thanks for sharing. I read many of your blog posts, cool, your blog is very good.

I do believe all the ideas youve presented for your post They are really convincing and will certainly work Nonetheless the posts are too short for novices May just you please lengthen them a little from subsequent time Thanks for the post

Noodlemagazine This is my first time pay a quick visit at here and i am really happy to read everthing at one place

Thank you for your sharing. I am worried that I lack creative ideas. It is your article that makes me full of hope. Thank you. But, I have a question, can you help me?

Technology us I am truly thankful to the owner of this web site who has shared this fantastic piece of writing at at this place.

Noodlemagazine This is my first time pay a quick visit at here and i am really happy to read everthing at one place

Its like you read my mind You appear to know so much about this like you wrote the book in it or something I think that you can do with a few pics to drive the message home a little bit but instead of that this is excellent blog A fantastic read Ill certainly be back

Blue Techker I just like the helpful information you provide in your articles

FinTech ZoomUs For the reason that the admin of this site is working, no uncertainty very quickly it will be renowned, due to its quality contents.

Isla Moon naturally like your web site however you need to take a look at the spelling on several of your posts. A number of them are rife with spelling problems and I find it very bothersome to tell the truth on the other hand I will surely come again again.

Isla Moon Good post! We will be linking to this particularly great post on our site. Keep up the great writing

Blue Techker You’re so awesome! I don’t believe I have read a single thing like that before. So great to find someone with some original thoughts on this topic. Really.. thank you for starting this up. This website is something that is needed on the internet, someone with a little originality!

Blue Techker I do not even understand how I ended up here, but I assumed this publish used to be great

Blue Techker I do not even understand how I ended up here, but I assumed this publish used to be great

BYU Cougars This was beautiful Admin. Thank you for your reflections.

Excellent blog here Also your website loads up very fast What web host are you using Can I get your affiliate link to your host I wish my web site loaded up as quickly as yours lol

Henof I really like reading through a post that can make men and women think. Also, thank you for allowing me to comment!

I have been browsing online more than three hours today yet I never found any interesting article like yours It is pretty worth enough for me In my view if all website owners and bloggers made good content as you did the internet will be a lot more useful than ever before

helloI really like your writing so a lot share we keep up a correspondence extra approximately your post on AOL I need an expert in this house to unravel my problem May be that is you Taking a look ahead to see you

I was suggested this web site by my cousin Im not sure whether this post is written by him as no one else know such detailed about my trouble You are incredible Thanks

Hi Neat post Theres an issue together with your web site in internet explorer may test this IE still is the marketplace chief and a good component of people will pass over your fantastic writing due to this problem

Simply Sseven Very well presented. Every quote was awesome and thanks for sharing the content. Keep sharing and keep motivating others.

I have been surfing online more than 3 hours today yet I never found any interesting article like yours It is pretty worth enough for me In my opinion if all web owners and bloggers made good content as you did the web will be much more useful than ever before

I just could not leave your web site before suggesting that I really enjoyed the standard information a person supply to your visitors Is gonna be again steadily in order to check up on new posts

helloI like your writing very so much proportion we keep up a correspondence extra approximately your post on AOL I need an expert in this space to unravel my problem May be that is you Taking a look forward to see you

Nutra Gears For the reason that the admin of this site is working, no uncertainty very quickly it will be renowned, due to its quality contents.

Bài viết rất hay! Tôi đã học được rất nhiều điều từ bài viết này.

Beautifully composed piece that provides valuable perspectives. I’m impressed by the depth of your research and analysis.

Simply wish to say your article is as amazing The clearness in your post is just nice and i could assume youre an expert on this subject Well with your permission let me to grab your feed to keep updated with forthcoming post Thanks a million and please carry on the gratifying work

Vitazen Keto Gummies This is really interesting, You’re a very skilled blogger. I’ve joined your feed and look forward to seeking more of your magnificent post. Also, I’ve shared your site in my social networks!

Thank you for the good writeup It in fact was a amusement account it Look advanced to far added agreeable from you However how could we communicate

Temp Mail Hi there to all, for the reason that I am genuinely keen of reading this website’s post to be updated on a regular basis. It carries pleasant stuff.

Temp Mail This is my first time pay a quick visit at here and i am really happy to read everthing at one place

you are truly a just right webmaster The site loading speed is incredible It kind of feels that youre doing any distinctive trick In addition The contents are masterwork you have done a great activity in this matter

I was recommended this website by my cousin I am not sure whether this post is written by him as nobody else know such detailed about my difficulty You are wonderful Thanks

What i dont understood is in reality how youre now not really a lot more smartlyfavored than you might be now Youre very intelligent You understand therefore significantly in terms of this topic produced me personally believe it from a lot of numerous angles Its like women and men are not interested except it is one thing to accomplish with Woman gaga Your own stuffs outstanding Always care for it up

Hi my family member I want to say that this post is awesome nice written and come with approximately all significant infos I would like to peer extra posts like this

Excellent blog here Also your website loads up very fast What web host are you using Can I get your affiliate link to your host I wish my web site loaded up as quickly as yours lol

Wow wonderful blog layout How long have you been blogging for you make blogging look easy The overall look of your site is great as well as the content

I was suggested this web site by my cousin Im not sure whether this post is written by him as no one else know such detailed about my trouble You are incredible Thanks

you are in reality a good webmaster The website loading velocity is amazing It sort of feels that youre doing any distinctive trick Also The contents are masterwork you have done a fantastic job in this topic

I am truly thankful to the owner of this web site who has shared this fantastic piece of writing at at this place.

Your website is a great place for me to learn new things, and I appreciate it. Enjoy your journey to shine a light on people’s minds with your amazing writing.